"Claude Code" bilan hazillashmang: Anthropic o‘z terminali orqali dasturchini bloklab qo‘ydi

Anthropic kompaniyasining "Claude Code" deb nomlangan yangi terminal vositasi dasturchilar ishini inqilobiy darajada osonlashtirishni va'da qilgan edi. Biroq, yaqinda sodir bo'lgan voqea ushbu vositaning naqadar "shafqatsiz" bo'lishi mumkinligini ko'rsatib berdi. Dasturchi Hugo Daniel o'zining shaxsiy blogida ushbu vosita yordamida kod yozish jarayonida kutilmaganda bloklab qo'yilgani haqida yozib, butun IT hamjamiyatini ogohlikka chaqirdi.

Claude Code: Bu shunchaki yordamchi emas

Claude Code — bu Anthropic tomonidan ishlab chiqilgan CLI (Command Line Interface) vositasi bo'lib, u bevosita kompyuteringiz terminalida ishlaydi. U kod bazasini tahlil qilish, xatolarni tuzatish va yangi funksiyalar qo'shish imkonini beradi. Oddiy qilib aytganda, bu sizning terminalingiz ichidagi "aqlli hamkor"dir. U fayllaringizni o'qiy oladi, buyruqlarni bajara oladi va hatto testlarni ishga tushiradi.

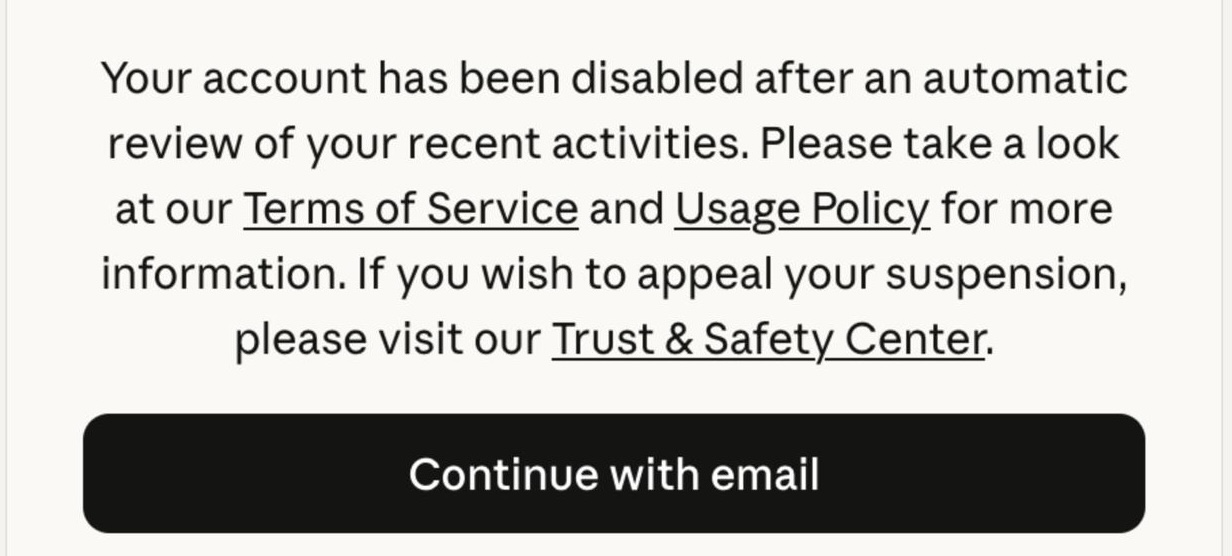

Biroq, Hugo Daniel misolida ko'rinib turibdiki, bu yordamchi haddan tashqari ehtiyotkor va ba'zida tushunarsiz qarorlar qabul qilishi mumkin. U o'z loyihasini optimallashtirish va refaktoring qilish jarayonida kutilmagan "Your account has been disabled" (Sizning hisobingiz bloklandi) degan xabarni oldi.

Nega tizim dasturchini "ban" qildi?

Ma'lum bo'lishicha, Claude Code o'rnatilgan murakkab xavfsizlik protokollariga ega bo'lib, ular so'rovlarni va generatsiya qilinayotgan kodni real vaqt rejimida tahlil qiladi. Hugo Daniel o'z tajribasida muayyan murakkab algoritmlar ustida ishlayotganda, tizim buni "potentsial xavfli faoliyat" yoki Anthropic xizmat ko'rsatish shartlariga (TOS) zid deb baholagan.

Eng qizig'i shundaki, dasturchi hech qanday g'arazli niyatda bo'lmagan, shunchaki standart dasturlash vazifasini bajargan. Bu esa sun'iy intellekt vositalarining markazlashgan boshqaruvi bilan bog'liq asosiy muammoni yuzaga chiqarmoqda: agar algoritm sizning kodingizni "shubhali" deb topsa, siz nafaqat vositadan, balki butun Anthropic ekotizimidan mahrum bo'lishingiz mumkin.

Sun'iy intellekt xavfsizligi va dasturchi erkinligi muvozanati

Anthropic doimo sun'iy intellekt xavfsizligiga (AI Safety) eng ustuvor vazifa sifatida qarab keladi. Biroq, Claude Code holatida bu xavfsizlik filtrlari dasturchilarning ijodiy va professional erkinligini cheklab qo'yayotgandek tuyulmoqda. Danielning tajribasi shuni ko'rsatadiki, hatto qonuniy maqsadlarda foydalanilganda ham, AI kontekstni noto'g'ri tushunishi va foydalanuvchini jazolashi mumkin.

Bu voqeadan so'ng, dasturchilar orasida quyidagi savollar tug'ilmoqda:

- AI vositalari bizning kodimiz ustidan qanchalik nazoratga ega?

- Bloklanish holatida apellyatsiya jarayoni qanchalik shaffof?

- Kelajakda murakkab loyihalarni AI'ga ishonib topshirish xavfsizmi?

Dasturchilar uchun muhim dars

Ushbu voqea AI ishlab chiquvchilar uchun ham, foydalanuvchilar uchun ham katta darsdir. Avtomatlashtirilgan moderatorlik tizimlari hali mukammal emas va ular ba'zan "false positive" (asossiz xavf) holatlarini keltirib chiqaradi. Claude Code kabi kuchli vositalar ommalashgani sayin, foydalanuvchilarni asossiz bloklash holatlari ko'payishi xavfi bor.

Hozircha, Claude Code hali ham beta-sinov bosqichida ekanligini unutmaslik kerak. Anthropic foydalanuvchilarning ushbu e'tirozlariga qanday javob berishi va xavfsizlik filtrlari hamda foydalanuvchi tajribasi o'rtasidagi oltin muvozanatni qanday topishi kelajakda ushbu vositaning taqdirini belgilab beradi.

Maqola Muhokamasi

Fikr va mulohazalaringiz.

Hali muhokamalar yo'q. Birinchi bo'lib fikr bildiring!