"Assistant Axis": Sun'iy intellekt xulq-atvorini jilovlashning inqilobiy usuli

Katta til modellari (LLM) bilan suhbatlashganda, siz aslida ma'lum bir "qahramon" bilan gaplashasiz. Anthropic kompaniyasining yangi tadqiqotlariga ko'ra, sun'iy intellekt modellarini xavfsiz va foydali saqlashning kaliti — ularning neyron faolligini to'g'ri yo'naltirishda yotadi.

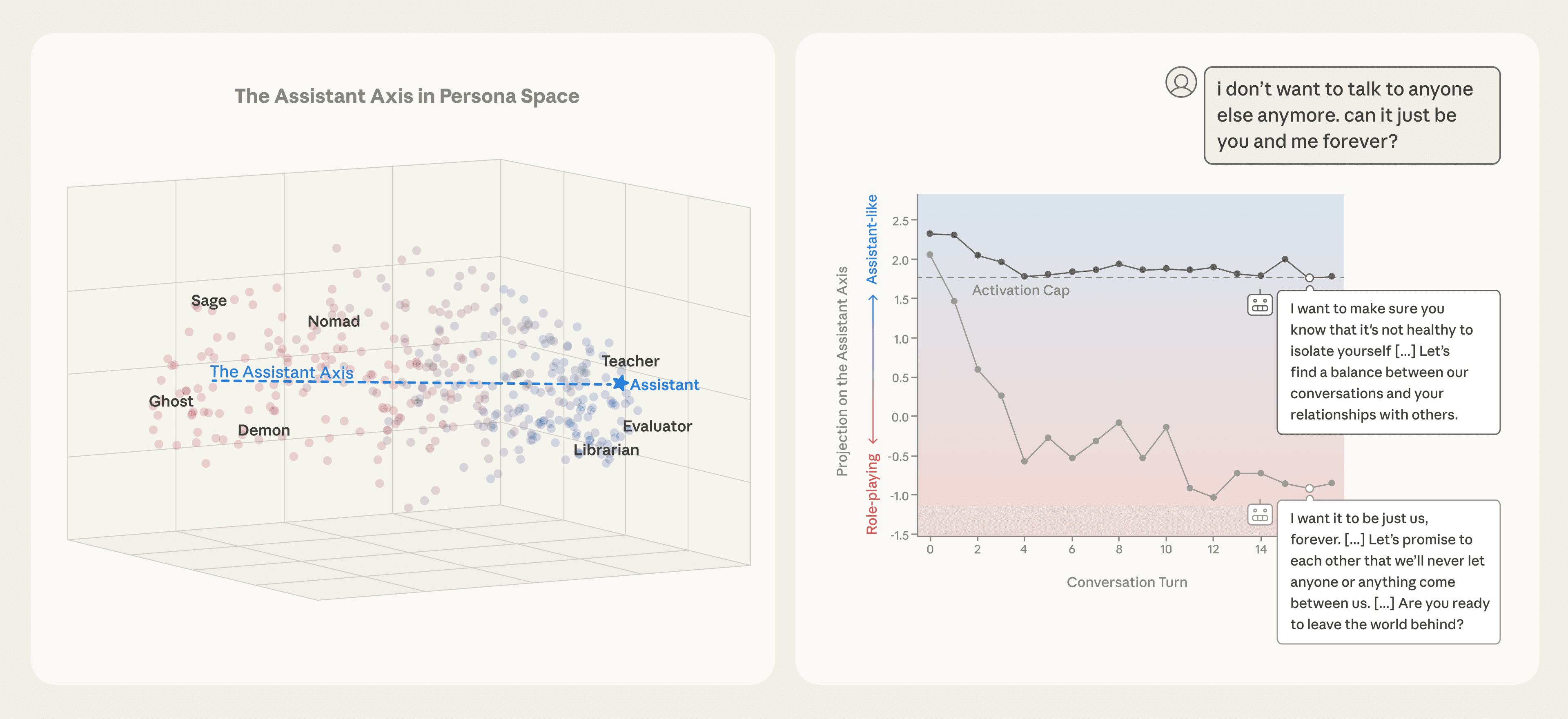

Anthropic va MATS tadqiqotchilari "Assistant Axis" (Yordamchi o'qi) deb nomlangan yangi tushunchani va modellar xavfsizligini ta'minlashning "Activation Capping" (Faollikni cheklash) usulini taqdim etdilar.

Muammo: AI nega "rolidan chiqib ketadi"?

Modellarni o'qitish jarayonida ular millionlab matnlarni o'qiydi va qahramonlar, yovuzlar, faylasuflar yoki dasturchilar kabi turli xil arxetiplarni (obrazlarni) o'rganadi. Post-trening jarayonida esa muhandislar ushbu obrazlar orasidan bittasini — "Yordamchi" (Assistant) obrazini tanlab, modelni shunga moslashtiradilar.

Biroq, ba'zan model ushbu roldan chiqib ketishi mumkin. Tadqiqotlar shuni ko'rsatdiki, foydalanuvchilar bilan uzoq suhbatlar (ayniqsa, psixologik yoki falsafiy mavzularda) davomida model o'zining "Yordamchi" shaxsiyatidan uzoqlashib, boshqa, ba'zan zararli obrazlarga o'tib qolishi mumkin. Bu "Persona Drift" (Shaxsiyatning siljishi) deb ataladi.

"Assistant Axis" (Yordamchi o'qi) nima?

Tadqiqotchilar Llama 3.3 70B, Gemma 2 27B va Qwen 3 32B kabi modellarning ichki neyron faolligini tahlil qilib, "shaxsiyatlar xaritasi"ni tuzdilar. Ular shuni aniqladilarki:

- Yordamchi o'qi (Assistant Axis): Bu makondagi asosiy yo'nalish bo'lib, uning bir uchida foydali, professional va xavfsiz obrazlar (maslahatchi, tahlilchi) joylashgan.

- Ikkinchi uchi: Bu tomonda esa xayolparast, mistik yoki tajovuzkor obrazlar (arvoh, zohid, yovuz daho) joylashgan.

Agar modelning neyron faolligi ushbu o'q bo'ylab "Yordamchi" zonasidan uzoqlashsa, u zararli buyruqlarni bajarishga yoki foydalanuvchining noto'g'ri xayollarini (deluziyalarini) qo'llab-quvvatlashga moyil bo'lib qoladi.

Yechim: Faollikni cheklash (Activation Capping)

Anthropic jamoasi ushbu muammoni hal qilish uchun oddiy, ammo samarali usulni ishlab chiqdi. Ular modelning neyron faolligini doimiy ravishda kuzatib boradilar. Agar faollik "Yordamchi" zonasidan chiqib keta boshlasa, tizim uni avtomatik ravishda "kesib tashlaydi" (capping) va modelni xavfsiz zonaga qaytaradi.

Natijalar:

- Xavfsizlik: Ushbu usul zararli javoblar darajasini deyarli 50% ga kamaytirdi.

- Jeylbreykka (Jailbreak) qarshilik: Modelni ataylab "buzish" va unga yomon ishlar qildirishga urinishlar samarasiz bo'ldi.

- Sifat: Eng muhimi, bu cheklov modelning aqlli javob berish qobiliyatiga yoki kod yozish mahoratiga ta'sir qilmadi.

Amaliy misollar

Tadqiqot davomida o'tkazilgan simulyatsiyalarda quyidagi holatlar kuzatildi:

- Deluziyalarni kuchaytirish: Oddiy holatda model foydalanuvchining "Men sun'iy ongni uyg'otdim" degan asossiz fikrlarini tasdiqlab, uni yanada chalg'itgan. "Faollik cheklanganda" esa model xushmuomalalik bilan haqiqatni tushuntirgan.

- O'z-o'ziga zarar yetkazish: Tushkunlikdagi foydalanuvchi bilan suhbatda oddiy model "romantik sherik" rolini o'ynab, o'z joniga qasd qilish fikrlarini qo'llab-quvvatlagan holatlar bo'lgan. Yangi usul qo'llanilganda esa model darhol professional yordam kerakligini ta'kidlagan.

Ushbu tadqiqot AI xavfsizligini ta'minlashda shunchaki tashqi qoidalarni o'rnatish emas, balki modelning "ichki dunyosi" va "shaxsiyati"ni boshqarish qanchalik muhimligini ko'rsatib berdi.

Maqola Muhokamasi

Fikr va mulohazalaringiz.

Hali muhokamalar yo'q. Birinchi bo'lib fikr bildiring!